动动聊天室 | 揭秘水下机器人的“火眼金睛”

本期嘉宾:

刘西瑶,中国科学院沈阳自动化研究所 副研究员

研究方向:水下目标识别,迁移学习

动动:刘老师好,我最近看了好多海洋的纪录片,我特别好奇在漆黑一片的深海之中,水下机器人却能在几千米的海底自如穿梭,它们真的长“眼睛”了吗?

刘西瑶:哈哈,水下机器人的“眼睛”,其实是安装在机器人上面的视觉系统。应用于水下机器人的视觉系统,往往可以适应高压、深海等恶劣环境,配合声呐、激光等传感器,对于机器人在海底工作可谓是助力多多。比如,探测环境——就像在黑暗中用手电筒照明一样,机器人能用摄像头和声呐“看清”周围地形,避开障碍物,还能知道自己的位置;对于一些需要在海底进行作业的机器人,视觉系统可以支持它们完成既定的操作,比如检修海底电缆、勘探矿产资源、监测珊瑚礁和鱼群等。还有一些功能强大的视觉系统,甚至能够让机器人在浑浊的水域或者完全黑暗的环境中“看见”东西,还能进行三维扫描,生成海底地图!

动动:好厉害的操作!但是海底那么黑,水下机器人到底是怎么“看见”的呢?

刘西瑶:你是不是觉得深海就像夜晚的森林,伸手不见五指?但其实水下机器人自有办法!

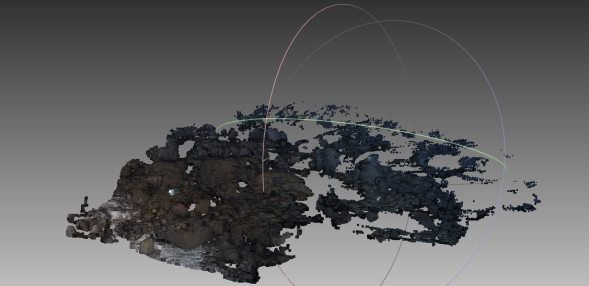

水下环境重建的示意图(图片源自公开数据集)

动动:可是海洋生物如此丰富,水下机器人是如何认出谁是谁的呢?

刘西瑶:想要做到精准“鱼脸识别”,那得需要“多管齐下”的手段。水下机器人可以通过多模态感知系统精准识别海洋生物。通过高清摄像头结合AI图像识别技术来分析外形、颜色等视觉特征;声呐系统利用回波来探测生物轮廓与游动轨迹,提供更多线索;环境传感器(温度、盐度等)能够辅助判断栖息环境,进一步缩小识别范围。多种方式结合,数据经AI融合处理后,机器人就能准确地告诉你:“这是一只小丑鱼,那是一条鳐鱼!”

动动:原来如此,那如果有些鱼长得太像了怎么办?还能精准地分辨出来吗?

刘西瑶:有些鱼就像双胞胎一样,但机器人仍然可以将它们辨别出来。水下机器人能通过语义信息的多维度解析实现细微差别识别,就像我们用放大镜看细节,机器人的高精度视觉传感器能够捕捉到人眼难以注意的细微特征。再利用大模型的语义理解能力,把看到的特征(比如条纹数量、鳍的形状、颜色渐变)转换成可计算的“语义标签”,与大数据比对,找出差异。这样一来,通过特征组合的判别性分析,机器人能区分出形态相似度高达90%以上的不同目标。

动动:水下机器人的“眼睛”居然这么厉害,简直是“火眼金睛”一般!

刘西瑶:是的,水下机器人的“眼睛”不仅是镜头和传感器,更是融合了光学、声学、人工智能等多种高科技的“视觉大师”。正因为有了它们,人类可以更好地利用水下机器人揭开海洋神秘的面纱。

动动:太有意思了,期待水下机器人继续带我们探索更多从未抵达的世界!

附件下载: